Apple è al lavoro per dotare i suoi dispositivi più popolari di alcune funzionalità che li renderanno dei veri e propri campioni nel panorama dell’accessibilità. Stiamo parlando di funzioni, annunciate per il futuro, che Apple ha intenzione di introdurre sui due device, a supporto di ciechi, ipovedenti e non solo.

Se mai vi foste chiesti a cosa serve il sensore LiDAR su iPad, ebbene, la risposta potrebbe presto essere più popolare di quanto pensiamo. Se, fino ad ora, il sensore è stato sfruttato in ambito professionale – architettura e, in generale, laddove fosse necessario analizzare gli ingombri di un ambiente -, quello che Apple ha intenzione di fare da qui al prossimo futuro va in una direzione di accessibilità. In occasione della giornata mondiale dell’accessibilità del 19 maggio, la mela ha infatti preannunciato alcune funzioni che vedremo presto su iPhone, iPad, Apple Watch e Mac.

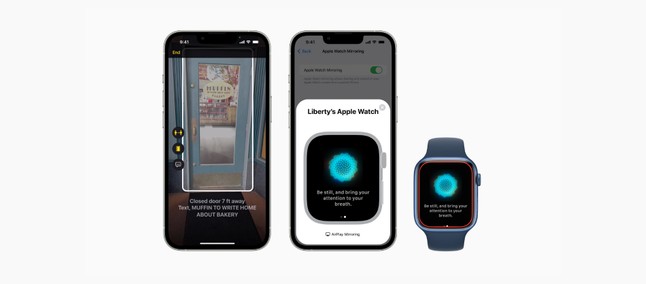

Si parte con Door Detection, una funzione dedicata agli ipovedenti e alla loro quotidianità, ma anche per chi ha disabilità fisiche e motorie. E ancora Apple Watch Mirroring, con Controllo vocale e Controllo interruttori; Live Captions e VoiceOver sono invece pronte ad introdurre 20 nuove lingue.

Door Detection, un’analisi ai raggi X delle porte

Door Detection altro non è che un aiuto per ipovedenti e ciechi volto ad individuare e segnalare la presenza di una porta. Viene inoltre segnalata la distanza e la presenza di eventuali ostacoli, come si apre la porta, se va spinta o tirata e se la maniglia va ruotata in senso orario o antiorario. In altre parole, c’è un’analisi ai raggi X – letteralmente! – delle porte che circondano l’ambiente. Il tutto grazie al sensore LiDAR presente su iPhone ed iPad (o almeno, su alcuni modelli, cioè iPhone 12 Pro e Pro Max, iPhone 13 Pro e Pro Max, iPad Pro da 11″ di seconda e terza generazione e da 12.9″ di quinta generazione).

Mirroring: comandi vocali e controlli degli interruttori

Passando invece ad Apple Watch, quest’ultimo integrerà le nuove funzioni di accessibilità grazie al Mirroring, che potrà essere controllato tramite voce con Controllo vocale e Controllo interruttori di iPhone. Ovviamente, grazie a queste novità, non sarà più necessario controllare i display tramite il tocco con i polpastrelli, ma basterà appunto un semplice comando vocale.

Live Captions e Voice Over: sottotitoli generati automaticamente e 20 nuove lingue in arrivo

Infine Live Captions e Voice Over per iPhone, iPad e Mac: la prima genera sottotitoli in tempo reale – la stessa modalità adottata da Google con i suoi Pixels. La seconda, in arrivo su Mac, permetterà di digitare una risposta e darà il benvenuto a 20 nuove lingue, tra cui ucraino, vietnamita, bulgaro, bengalese e catalano.

Apple si è detta molto soddisfatta delle novità legate all’accessibilità: “Siamo felici di presentare queste novità, espressione dello spirito creativo e innovativo dei team di Apple utilizzato per offrire agli utenti maggiori opportunità per utilizzare i nostri prodotti in modo più aderente alle esigenze e al quotidiano di ciascuno“ – ha detto Sarah Herrlinger, Senior Director of Accessibility Policy and Initiatives di Apple.